Andiamo incontro alla pausa pasquale, ma l’AI e l’innovazione non si fermano.

Iniziate a segnarvi il 20 maggio, che mi troverete all’AI Week, ma arriverò più avanti a dirvi cosa farò! Settimana prossima, salvo novità clamorose, non ci sarà Techy, pretendo che siate tutti a godervi la pasquetta!

Nel frattempo qui trovate la versione podcast automatica.

L’intelligenza artificiale sostituirà i sistemi aziendali (?)

C’è una frase che sento ripetere molto spesso: l’AI sostituirà i sistemi aziendali.

Francamente, quando la sento sorrido e lancio uno sguardo di scherno. Martedì, in una conversazione, una persona che aveva detto la frase mi ha chiesto “perché non sei convinto, guarda che è così”.

La mia risposta è sempre la stessa, probabilmente qualcuno di voi che sta leggendo mi ha sentito pronunciarla o l’ha letta in qualche mio scritto: “l’AI si alimenta dei dati aziendali e, almeno per il momento, le applicazioni sono lo strumento migliore per creare e gestire questi dati”.

Ci sono poi due temi per nulla secondari: il costo dell’AI, che anche se decresce, ha un impatto per cui ogni “consiglio chiesto” costa parecchio, in secondo luogo deve rispettare le policy, del settore a cui appartiene all’azienda e dell’azienda stessa. Si tratta di processi operativi e di collegamenti e adattamenti. Di preciso, in che cosa l’AI, per come la conosciamo ora, anche quella agentica avanzata, potrebbe sostituire i software tradizionali?

Ho chiuso con questa frase: “Ma secondo te, perché le aziende di software si impegnano nel creare AI interne ai sistemi e agenti (Oracle da sola ne ha più di 400 per i propri prodotti)? Se pensassero di essere finiti venderebbero solo gli agenti e l’AI, non ti pare?

Attendo ancora una risposta ;) . Magari anche da te!

E gli USA condannano le piattaforme per come sono progettate…

Una storica sentenza a Los Angeles ha condannato Meta e YouTube per negligenza nel design. La giuria ha stabilito che le piattaforme sono responsabili per l’architettura delle loro piattaforme, considerata progettata per creare dipendenza. Ciò significa che è l’algoritmo a decidere cosa mostrare per catturare l’attenzione, invece che i contenuti generati dagli utenti.

Non vi suona un po’ come quelle leggi europee che impongono un controllo e una responsabilità?

Lo so che c’è una parte scomoda: l’applicazione pratica delle varie leggi è complessa, specie per modelli e sistemi erogati via cloud extra-UE. Ma per aziende che vendono in Europa, poter dimostrare conformità by design può diventare un forte argomento commerciale verso clienti, dalle piccole aziende fino alle grandissime e alla PA.

I tagli agli investimenti in data center AI

OpenAI si trova in una situazione complessa dopo l’annuncio del progetto “Stargate” da 1400 miliardi di dollari, che ora è stato ridotto a 600 miliardi. La società non ha ancora un data center e dipende da Oracle, Microsoft e Amazon per il calcolo. La costruzione di nuove infrastrutture è un processo molto lungo, che può durare tra i tre e i dieci anni. Ora, OpenAI deve dimostrare di poter generare ricavi sostenibili per poter effettuare una possibile IPO e quindi si sta riposizionando lato bilancio, ma nel frattempo la concorrenza sui modelli si sta facendo molto agguerrita.

Ma sempre OpenAI punta a raddoppiare il personale

OpenAI punta a passare da circa 4.500 a 8.000 dipendenti entro fine 2026, con assunzioni soprattutto in ingegneria, ricerca e vendite, secondo il Financial Times. Il piano arriva mentre Microsoft, Nvidia e Amazon stanno trattando per investire decine di miliardi nel maxi-round da 100 miliardi di dollari dell’azienda alla base di ChatGPT.

Nel frattempo, Alphabet (Google), Amazon, Meta e Microsoft pianificano complessivamente fino a 650 miliardi di dollari di spesa in infrastrutture AI entro il 2026, tra data center, GPU e rete.

Microsoft Copilot sta correndo ai ripari

Una delle obiezioni che sento fare più spesso da chi fatica ad utilizzare Copilot è che “non funziona bene se non dentro le applicazioni di Office e preferisco usare ChatGPT”. Ovviamente Copilot usa gli stessi modelli di ChatGPT, ma il suo funzionamento era mitigato, nel senso che il prompt veniva “interpretato” per ridurre il numero di token usati e questa modifica aveva un impatto sulle risposte. L’azienda, dal canto suo, è concentrata sui propri prodotti ed era normale che funzionasse così. Sembra che questo approccio stia cambiando radicalmente, un po’ con l’apertura ad altri modelli LLM, un po’ per un passaggio a funzioni agentiche che in tanti forum si vociferano. Insomma, anche Copilot non è più quello di una volta e, per esempio, l’integrazione in Windows sarà sempre più spinta (ma è sempre un prodotto di punta dell’azienda). Vedremo.

Arm entra nella competizione dei processori per data center

Arm annuncia il cambiamento strategico di produrre direttamente chip, abbandonando il modello di licenza dei propri design. La prima CPU, Arm AGI, è destinata a server ad alte prestazioni e applicazioni di intelligenza artificiale agentica. Prodotta da TSMC con processo 3 nm e si integra con altri chip nei data center per gestire compiti agentici. Arm sostiene che sarà la CPU più efficiente per queste applicazioni. Sono inclusi primi clienti come Meta, OpenAI e SK Telecom. La produzione completa è prevista entro la seconda metà del 2026.

Se gli italiani distillano modelli specializzati…

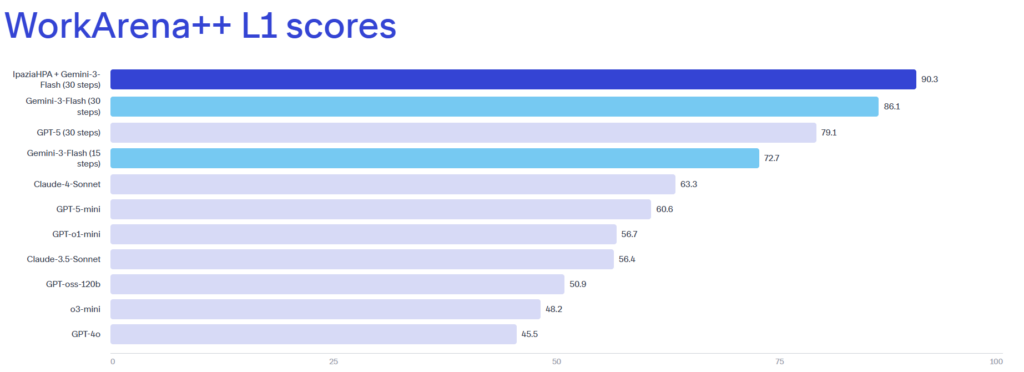

Ipazia, una boutique tecnologica milanese fondata nel 2021 da Giorgio Alverà, ha sorprendentemente superato i modelli di punta di Google e OpenAI nel benchmark WorkArena++. In questo contesto, i modelli linguistici sono valutati non solo sulla loro capacità di generare testi, ma anche di eseguire processi di business complessi come navigare liste prodotti, ordinare articoli e recuperare dati da database. I risultati sono sorprendenti: Ipazia ha ottenuto un punteggio del 90,3%, mentre Gemini-3 Flash di Google raggiungeva l’86,1%, GPT-5 di OpenAI l’79,1% e Claude-4-Sonnet di Anthropic solo il 63,3%.

Il modello AI del cervello umano

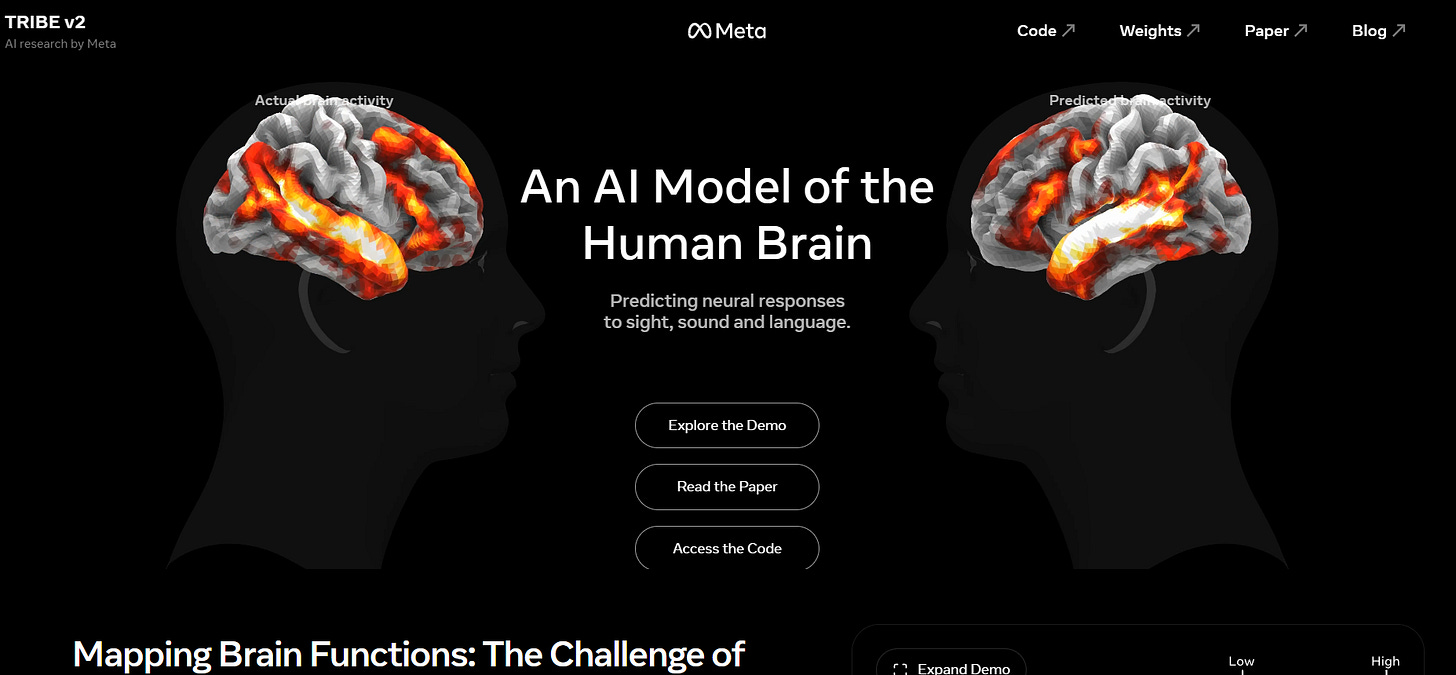

La neuroscienza si affronta da decenni un grande ostacolo: la necessità di nuove registrazioni di attività cerebrale per ogni nuovo esperimento. Questo rallenta, rende costoso e complesso comprendere meccanismi cerebrali. Meta ha presentato TRIBE v2, un modello di base digitale che riflette l’attività cerebrale umana in risposta a visione, suono e linguaggio, trasformando mesi di lavoro di laboratorio in secondi di calcolo. Il modello, a tre stadi, predice attività cerebrale utilizzando: codifiche multimodalistiche per catturare le caratteristiche condivise tra modelli di IA e cervello umano; processamento tramite un trasformatore che apprende rappresentazioni universali comuni a tutte le stimolazione, compiti e individui; mappatura del cervello che traduce queste rappresentazioni in individui su voxel fMRI, 3D pixel.

L’assistente tutto fare di Zuckerberg sarà un agente

Mark Zuckerberg starebbe testando un assistente virtuale personale, un agente AI, per supportarlo nella direzione di Meta, come riportato dal Wall Street Journal. L’obiettivo è trasformare l’azienda in un’entità tecnologicamente autonoma, con l’intelligenza artificiale come motore organizzativo, riducendo la necessità di team intermediari e aumentando l’automazione.

La società ha annunciato la chiusura di Horizon Worlds VR, un progetto chiave per il Metaverso, solo per poi ricredersi e riconsiderare la decisione.

Un sistema per limitare l’uso della RAM (sempre più costosa)

L’attuale aumento del prezzo dei componenti RAM è un problema per molti. Per mitigarlo, stiamo introducendo un nuovo sistema di ottimizzazione della memoria ComfyUI chiamato Dynamic VRAM. Questo sistema rivoluziona la gestione delle pesi dei modelli, rendendo l’esperienza più fluida anche per i utilizzi con hardware a bassa capacità di memoria. Tra le novità ci sono una riduzione dei consumi di RAM, la scomparsa degli errori OOM e tempi di caricamento più rapidi.

E anche Google si è mossa sulla gestione della memoria

Google Research ha sviluppato un nuovo algoritmo chiamato TurboQuant che risolve un problema chiave dell’AI generativa: la memoria. Grazie a questo innovativo approccio, i modelli AI possono essere resi 8 volte più veloci e consumare 6 volte meno spazio senza compromettere l’accuratezza. Il segreto di quest’impareggiabile performance sta nella compressione dei vettori di numeri utilizzati dai modelli AI da 32 valori a soli 3, riducendo lo spazio occupato da un sesto. Questo è possibile grazie alla rappresentazione dei vettori come coordinate polari, anziché salvare ogni coordinata precisa. Le implicazioni di questo innovativo metodo sono enormi e possono portare a un utilizzo più efficiente delle risorse, a modelli AI eseguibili in locale con maggiore sicurezza e a costi più tollerabili per le memorie.

Gemini punta molto sulla voce

Gemini 3.1 Flash Live, il nuovo modello per agenti conversazionali in tempo reale, è ora disponibile in anteprima tramite l’API Live di Google AI Studio. Questo upgrade migliora la latenza, la affidabilità e la qualità del dialogo naturale, permettendo ai sviluppatori di creare agenti vocali e visivi in tempo reale capaci di comprendere il mondo e rispondere rapidamente.

Mistral e il text to speech

L’europea Mistral ha rilasciato un nuovo modello di Text-to-Speech (TTS) chiamato Voxtral, un modello da 4B di parametri open-source che sta dando battaglia ai leader di mercato. È incredibile quanto sia veloce: necessita solo di 3 secondi di audio per clonare una voce. La sua superiorità rispetto alle altre tecnologie è evidente: batte ElevenLabs con un win-rate del 68,4% e ha un’architettura ibrida che combina il decoding autoregressivo e il flow-matching per creare suoni naturali senza la “bronchite” robotica. È multilingua e supporta già 9 lingue con ottimi risultati. Un nuovo game-changer del mondo dell’AI?

Il riconoscimento vocale migliore è Open Source

Cohere annuncia Transcribe, un modello di riconoscimento della parola automatica (ASR - Automatic Speech Recognition) di ultima generazione disponibile gratuitamente per il download. L’obiettivo era migliorare la precisione del modello ASR in condizioni pratiche, mantenendo disponibilità e basso consumo di risorse. Transcribe è quindi disponibile in open source, con pieno controllo dell’infrastructure, piccoli footprint di inferenza, alta efficienza di servizio e integrazione via Model Vault, il platform di inferenza gestito da Cohere. Transcribe risulta primo nella classifica ASR di HuggingFace, stabilendo un nuovo benchmark per la precisione nella trascrizione della parola. Ovviamente c’è l’italiano.

Creare facimente mondi 3D da immagini

Il metaverso è morto, dice qualcuno, eppure sta influenzando tantissime applicazioni. Per esempio, WorldAgents utilizza un’architettura multi-agente per creare mondi 3D coerenti a partire da modelli 2D. La sintesi è affidata a tre agenti: il Direttore elabora le mosse, il Generatore crea nuove prospettive, il Verificatore seleziona e cura le immagini da entrambi lo spazio 2D e 3D.

Il McDonald con gli umanoidi

A Shanghai, un McDonald’s ha introdotto robot umanoidi dietro il bancone per servire i clienti e gestire alcune fasi del servizio, sviluppati da Keenon Robotics.

E se i robot ti costruiscono la casa di legno?

Vi lascio questo video, giusto per capire che direzione sta prendendo la robotica applicata.

La puntata di questa settimana del Late Tech Show

Ecco di cosa abbiamo parlato in questa puntata:

🏭 Industrial AI e Fabbriche Autonome Insieme a Floriano Masoero (CEO di Siemens Italia), abbiamo approfondito come l'intelligenza artificiale stia diventando il vero "sistema operativo" dell'industria.

Dalla Physical AI alla manutenzione predittiva, scopriamo come la tecnologia democratica stia rendendo le aziende più veloci e sostenibili.

☁️ Sovranità Digitale e Cloud Europeo Con Damian Lucas di Scalaway (gruppo Iliad), facciamo il punto sull'infrastruttura cloud a Milano.

Perché è fondamentale per le aziende italiane affidarsi a un provider europeo immune da leggi extraterritoriali e capace di reinvestire il valore nel nostro ecosistema?

📱 Hardware e AI: Il nuovo Pixel 10A Torna Giovanni Bergamaschi (Google) per presentarci il nuovo dispositivo di fascia media che punta tutto su sicurezza (grazie al chip Tensor G4), sostenibilità e una totale integrazione con l'ecosistema Gemini.

🏠 Investimenti Immobiliari 3.0 Infine, entriamo nel mondo Fintech con il team di Piece: Riccardo Momigliano (Co-founder), Luigi Radicati di Brozolo (Head of Product) e Jader Manno (Growth Marketing Sales Leader).

Scopriamo come la blockchain e la tokenizzazione permettano di investire in immobili a reddito partendo da soli 100€, in modo trasparente e sicuro.re viaggiatori simili a te direttamente sul posto.

Versione su Youtube con i capitoli.

SmartBreak e Vita da ufficio

Faccio molta fatica a fare le mie live alle 11:00 e credo che anche questa settimana sarà dura…

Le puntate registrate le trovate qui.

Techy e oltre

Se non vi siete ancora iscritti, fatelo, mi permettete di comprendere che apprezzate il mio lavoro (qui trovi i miei libri, tra cui “Dati & AI” che riscuote sempre successo).

Più persone la leggono, meglio è, quindi, per favore, condividilo con la tua famiglia, amici e colleghi per far sì che gli effetti di rete si diffondano.

Assicurati di aggiungere gigibeltrame@substack.com ai tuoi contatti. In Gmail, trascina questa newsletter nella tua scheda principale.

Grazie per aver letto questa newsletter, le trovi tutte a questo link.

Se ti va, contattami a questo link!

💁♂️ La Bio

👍 Seguimi su:

Magazine • LinkedIn • Instagram • Facebook • Youtube

Iscriviti gratuitamente per ricevere nuovi post e supportare il mio lavoro.

Grazie per aver letto Techy di Gigi Beltrame! Iscriviti gratuitamente per ricevere nuovi post e supportare il mio lavoro.

Un blog per parlare di cultura digitale, prodotti, servizi e molto, molto di più.

Un blog per parlare di cultura digitale, prodotti, servizi e molto, molto di più.