https://gigibeltrame.substack.com/p/cloudflare-ces-e-robotica-cosa-e

---------------

Tante le cose che mi sono appuntato questa settimana, a partire dalle tante novità arrivate dal CES, che per altro ho seguito meglio da qui che quando mi trovavo a Las Vegas!

Qui trovate la versione podcast automatica, se volete solo ascoltare…

Ma procediamo.

C’è una notizia che mi ha un po’ inquietato.

Il caso Cloudflare è importantissimo

Il caso Cloudflare, che ha minacciato di ritirare i suoi asset dall’Italia dopo una sanzione dell’Agcom, è una questione che non può essere sottovalutata.

Stiamo parlando di sicurezza, ma non può mai, a mio avviso ma spero anche di tanti, essere considerata come un elemento di negoziazione, altrimenti smette di essere sicurezza e diventa qualcos’altro che non mi piace.

Mi piacerebbe avere anche il vostro parere, da tecnici o da semplici utenti, perché credo che sia molto grave quanto ha proposto Cloudflare. Credo sia importante capire le responsabilità che oggi le big tech. Responsabilità reali.

Il presupposto per cui il Piracy Shield sia una legge palesemente ingiusta non giustifica il fatto che non la si rispetti e che si minacci di abbandonare tutto: ma che ragionamento sarebbe? Pensate se domattina Enel si sveglia e dice che l’IVA sulla corrente elettrica è ingiusta e quindi non porta più la corrente nelle case?

Fino a che non capiamo che certe aziende diventano infrastruttura anche per il digitale e che servono regole rigide come per le utility, non si andrà mai da nessuna parte.

Poi che Cloudflare metta a disposizione le proprie risorse pro bono per le olimpiadi è a sua volta una stortura del sistema.

Scrivimi o commenta

Le PMI non usano l’AI

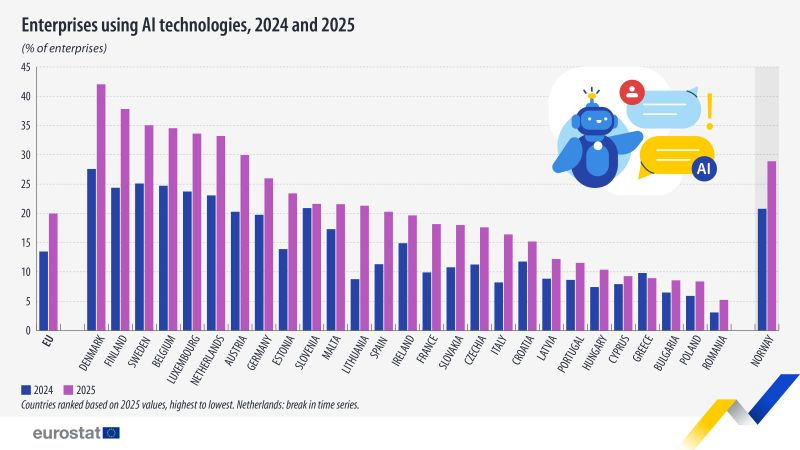

Solo il 20% delle imprese europee con oltre 10 dipendenti utilizza l’AI, con un aumento del 6,5% rispetto al 2024. In Italia, la percentuale è del 16,4%, sebbene sia raddoppiata rispetto all’anno precedente, rimane comunque al di sotto della media europea. Per questo motivo ho scelto di presentare dei team building, ma anche estesi alle PMI, per far comprendere meglio l’AI. Sono tutte personalizzabili alla grande. Contattatemi.

Elon Musk, CEO di xAI, Neuralink, Tesla e SpaceX, ha affermato, dopo aver raccolto sul mercato 20 miliardi di dollari per Xai, che “siamo entrati nella Singolarità tecnologica”, dove l’AI supera l’intelligenza umana, portando a progressi importanti. I modelli LLM sono in un vicolo cieco

Yann LeCun, importante figura dell’intelligenza artificiale, lascia Meta dopo oltre un decennio e critica la direzione della società in un’intervista al Financial Times. Secondo lui, i risultati di Llama 4 sono stati “un po’ falsati” e la leadership è stata messa da parte. LeCun ritiene che i grandi modelli linguistici siano “un vicolo cieco” per la superintelligenza.

Passiamo alle notizie che mi sono appuntato dal CES

Tante novità, ma pochissime di rilievo. Se non che la robotica, la physical AI è diventata una grossa realtà. Ma ci arriveremo per gradi.

Nvidia cambia passo (ancora)

Nvidia cambia registro al CES 2026, presentando una strategia orientata alle piattaforme integrate per l’intelligenza artificiale, le infrastrutture e la “physical AI”. La nuova architettura Vera Rubin è ottimizzata per l’addestramento di modelli complessi, con miglioramenti in termini di efficienza e costo. Sono stati anche presentati nuovi sistemi DGX, soluzioni di rete e modelli open per la guida autonoma e la robotica. Non sono state annunciate nuove GPU, ma è stata confermata l’espansione della tecnologia DLSS 4.5 e del servizio GeForce Now. Jensen Huang ha sottolineato l’importanza della “AI factory” per descrivere infrastrutture standardizzate dedicate all’addestramento e all’esecuzione di modelli di grandi dimensioni.

Il Mini PC per l’AI in locale di AMD

Il processore AMD Ryzen AI Halo è basato sulla serie Ryzen AI Max Plus e può eseguire modelli locali con fino a 200 miliardi di parametri, secondo quanto afferma AMD, che prevede di introdurlo nel secondo trimestre del 2026.

Il computer dentro la tastiera di HP

HP ha presentato l’Eliteboard G1, un computer miniaturizzato contenuto in una tastiera compatta. Al suo interno si trovano un chip AMD Ryzen AI, altoparlanti stereo, RAM, memoria, ventola e porte. Basta collegarlo a un monitor e utilizzare il mouse Bluetooth incluso per iniziare a lavorare.

Sono stati presentati 37 occhiali smart

Una follia planetaria: al CES sono stati presentati 37 occhiali smart (forse ne ho perso qualcuno). Segnalo qui quelli che mi hanno colpito e che potrebbero arrivare in Italia in futuro.

Lenovo ha presentato il concetto di occhiali intelligenti AI che rivoluzionano l’interazione con l’ambiente e unificano il flusso di lavoro, offrendo assistenza AI, controllo multimediale e integrazione multi-dispositivo. Gli occhiali, collegati wireless a un dispositivo intelligente, hanno controlli intuitivi touch e vocale, chiamate senza mani e un teleprompter per presentazioni. Sono alimentati da Lenovo Qira, che fornisce traduzione in tempo reale e riconoscimento di immagini intelligenti, grazie alle capacità AI dei dispositivi abbinati. Pesarono solo 45g e offrono fino a 8 ore di produttività e intrattenimento.

Gli occhiali IXI presentano un sistema di tracciamento oculare unico senza telecamera che utilizza LED e fotodiodi a basso consumo per monitorare i movimenti e la convergenza dell’utente, consentendo di cambiare focale da vicino a lontano in circa 0,2 secondi. Quando lo sguardo si sposta, gli occhiali tornano alla normale prescrizione, offrendo un’alternativa high-tech alle lenti multifocali tradizionali.

Asus ROG’s next ally is Xreal Xreal presenta nuove tecnologie al CES, tra cui gli occhiali AR 1S e il dock Neo. Inoltre, annuncia una collaborazione con Asus per creare occhiali AR ROG Xreal R1 per giocatori, con un tasso di aggiornamento di 240Hz, il doppio del solito 120Hz.

In futuro Netflix potrebbe introdurre ambienti 3D condivisi dove gli utenti entrano come avatar personalizzati, scelgono cinema virtuali, sale da soggiorno o spazi a tema, siedono accanto ad amici o altri spettatori e interagiscono naturalmente prima, durante e dopo la proiezione, grazie alla tecnologia “Ready Player Me”.

Samsung e lo schermo pieghevole senza pieghe (per Apple?)

Arriva un display OLED pieghevole senza piega visibile, un’innovazione che potrebbe ridefinire gli standard del settore e trovare la sua prima applicazione commerciale nell’atteso iPhone pieghevole di Apple.

Lego si getta sull’IOT

Il nuovo mattoncino smart dispone di sensori, luci, speaker, accelerometro e bobine per rilevare movimento, orientamento e posizione reciproca, ed è parte di Smart Play, un ecosistema con nuovi personaggi e smart tag per personalizzare il gioco.

Scoprire come stiamo da come dormiamo

Ricercatori di Stanford hanno sviluppato SleepFM, un modello di intelligenza artificiale che può prevedere oltre 130 condizioni di salute, come demenza, attacchi di cuore e Parkinson, da una singola registrazione notturna del sonno. Il modello è stato addestrato su 600.000 ore di dati del sonno di 65.000 partecipanti, analizzando onde cerebrali, attività cardiaca, respiro e segnali muscolari. SleepFM ha previsto la malattia di Parkinson con il 89% di accuratezza, la demenza all’85%, gli attacchi di cuore all’81% e il rischio generale di morte all’84%. Ciò potrebbe rivoluzionare il monitoraggio della salute.

OpenAI pensa alla salute

ChatGPT Health è un’esperienza dedicata che unisce informazioni sanitarie con l’intelligenza di ChatGPT per aiutare a gestire la propria salute. Si basa su controlli di privacy, sicurezza e gestione dei dati, con ulteriori livelli di protezione per la salute, come crittografia e isolamento delle conversazioni. Permette di collegare cartelle cliniche e app di benessere per ottenere risposte mirate e utili, ed è progettato per supportare l’assistenza medica, non sostituirla.

Mentre alcuni stati usano l’AI per le prescrizioni mediche

Lo Utah è il primo stato a consentire a un sistema di intelligenza artificiale di approvare prescrizioni mediche in modo legale e autonomo, grazie alla partnership con l’azienda di tecnologia sanitaria Doctronic. Il sistema copre 191 farmaci, tra cui quelli per la pressione sanguigna e i trattamenti per il controllo delle nascite, e funziona come dice il CEO di Doctronic che afferma “siamo sulla strada giusta per fornire ai pazienti con condizioni croniche un percorso più veloce per il rinnovo delle prescrizioni”.

La modifica delle immagini su X apre le porte alle fake news

Elon Musk ha annunciato su X la disponibilità di Grok, uno strumento di modifica immagini e video, per tutti gli utenti. L’opzione è accessibile facendo tap o clic sul pulsante in basso a destra e permette di modificare qualsiasi contenuto pubblicato, compresi quelli sensibili come Disney o Nintendo, con risultati spesso credibili e realistici, a rischio disinformazione e fake news.

Parliamo di robotica

Al CES è stato un florilegio di robot, che vale la pena ricordarlo significa “lavoro forzato”…

Ma partiamo con Musk, non al CES, che ha presentato “Optimus”, il robot umanoide di Tesla, che sarà il prodotto “più importante di sempre”, e “Neuralink”, che rivoluzionerà la medicina, ripristinando funzioni corporee e potenziando le capacità umane. “Sarà un futuro incredibile, di abbondanza per tutti”.

Nosh è un “robo-chef per la casa” che aiuta nella preparazione dei pasti. L’utente seleziona una ricetta, prepara gli ingredienti e li inserisce in appositi compartimenti. Il dispositivo cuoce il pasto utilizzando acqua, olio e spezie, controllando la cottura con una telecamera e un braccio miscelatore. Potrebbe essere più adatto a ristoranti o fast food che a cucine domestiche, ma rappresenta un passo avanti rispetto ai pasti surgelati cucinati al microonde.

Intanto si moltiplicano i filmati con i taxi autonomi che si “impantanano”.

Luis Central Tires on Instagram: "Waymo needs better drivers🤣

…

Apple Vision Pro e lo sport

Dal 9 gennaio alcune partite NBA saranno trasmesse su Apple Vision Pro in modalità immersiva e super realistica. La tecnologia offre sette angolazioni uniche, telecronaca affidata a Mark Rogondino e Danny Green e statistiche 3D. L’audio spaziale garantisce una esperienza realistica, “come essere li’”. La piattaforma ha anche acquisito i diritti per la Formula 1 negli Stati Uniti e offre contenuti immersivi per la musica.

Libri, Late Tech Show che riprende e SmartBreak

Anche queste settimana devo ringraziarvi per i commenti al libro, mi sorprendete sempre! Continuate a farmi sapere qui le vostre opinioni e richieste.

Questa settimana riprendono le puntate del podcast, ma qui trovate l’ultima puntata del Late Tech Show.

Qui invece l’ultima puntata degli SmartBreak.

Fammi sapere cosa ti ha colpito delle cose che faccio o racconto nei vari eventi, o di quello che ascolti al Late Tech Show, piuttosto che negli SmartBreak (e dal podcast “Vita da ufficio“) o che leggi nella newsletter Techy.

Ti prego di farmi conoscere cosa pensi possa essere migliorato, aiutami con le critiche, e soprattutto quali temi vorresti che venissero approfonditi o trattati.

Scrivimi o commenta

Se non vi siete ancora iscritti, fatelo, mi permettete di comprendere che apprezzate il mio lavoro.

Più persone la leggono, meglio è, quindi, per favore, condividilo con la tua famiglia, amici e colleghi per far sì che gli effetti di rete si diffondano.

Assicurati di aggiungere gigibeltrame@substack.com ai tuoi contatti. In Gmail, trascina questa newsletter nella tua scheda principale.

Grazie per aver letto questa newsletter, le trovi tutte a questo link.

💻sito del Late Tech Show

💁♂️ La Bio

📚 Scopri i miei libri

Newsletter #Techy

👍 Seguimi su:

Magazine • LinkedIn • Instagram • Facebook • Youtube

Iscriviti gratuitamente per ricevere nuovi post e supportare il mio lavoro.

Grazie per aver letto Techy di Gigi Beltrame! Iscriviti gratuitamente per ricevere nuovi post e supportare il mio lavoro.

Un blog per parlare di cultura digitale, prodotti, servizi e molto, molto di più.

Un blog per parlare di cultura digitale, prodotti, servizi e molto, molto di più.